-

1 количество взаимной информации в случайных величинах

количество взаимной информации в случайных величинах

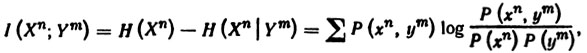

Мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усредненного по знаниям последней; для дискретных случайных величин ее выражение имеет вид

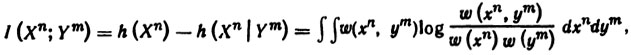

где суммирование ведется по всему множеству значений хn, уm случайных величин Xn, ym; для непрерывных случайных величин ее выражение имеет вид

где интегрирование ведется по всему множеству значений xn, уm случайных величин Хn, Уm.

Примечания

1. Вместо термина «количество взаимной информации в случайных величинах» иногда употребляют выражение «количество информации о случайной величине, содержащееся в другой случайной величине».

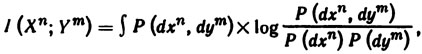

2. Общая форма математической записи выражения количества взаимной информации, справедливая в произвольном случае, имеет вид

где Р(хn, уm), Р(хn) и Р(уm) —вероятностные меры, заданные соответственно на множествах значений {хn, уm), хn и уm случайных величии (Xn, Уm), Хn и Уm.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > количество взаимной информации в случайных величинах

-

2 количество взаимной информации в случайных величинах

General subject: mutual information between two random variables (мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усре)Универсальный русско-английский словарь > количество взаимной информации в случайных величинах

-

3 количество взаимной информации в случайных последовательностях

количество взаимной информации в случайных последовательностях

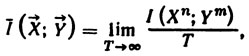

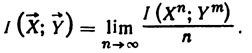

Отнесенное к единице времени количество информации в отрезке случайной последовательности относительно соответствующего отрезка другой случайной последовательности в пределе при стремлении к бесконечности длины отрезка; ее выражение имеет вид

где n и m —числа компонент последовательностей и

и  на длине отрезка T, а l (Хn; Уm)—количество взаимной информации в случайных величинах Хn и Уm.

на длине отрезка T, а l (Хn; Уm)—количество взаимной информации в случайных величинах Хn и Уm.

Примечания

1. Вместо термина «количество взаимной информации в случайных последовательностях» иногда употребляют выражение «количество информации о случайной последовательности, содержащееся в другой случайной последовательности».

2. Количество взаимной информации в случайных последовательностях, отнесенное к одной компоненте, имеет вид

3. Длина отрезка Т может иметь размерность, отличную от времени.

[Сборник рекомендуемых терминов. Выпуск 94. Теория передачи информации. Академия наук СССР. Комитет технической терминологии. 1979 г.]Тематики

EN

Русско-английский словарь нормативно-технической терминологии > количество взаимной информации в случайных последовательностях

-

4 независимые и одинаково распределённые

1) Mathematics: IID (о случайных величинах)2) Probability theory: i.i.d. (случайные величины), independent and identically-distributedУниверсальный русско-английский словарь > независимые и одинаково распределённые

-

5 независимые и распределённые по нормальному закону

Mathematics: NID (о случайных величинах)Универсальный русско-английский словарь > независимые и распределённые по нормальному закону

-

6 независимые нормально распределённые

Универсальный русско-английский словарь > независимые нормально распределённые

-

7 распределённая по нормальному закону

Quality control: normally independently distributed (о случайных величинах)Универсальный русско-английский словарь > распределённая по нормальному закону

См. также в других словарях:

количество взаимной информации в случайных величинах — Мера уменьшения неопределенности случайной величины, возникающего вследствие того, что становится известным значение другой случайной величины, усредненного по знаниям последней; для дискретных случайных величин ее выражение имеет вид где… … Справочник технического переводчика

количество взаимной информации в случайных последовательностях — Отнесенное к единице времени количество информации в отрезке случайной последовательности относительно соответствующего отрезка другой случайной последовательности в пределе при стремлении к бесконечности длины отрезка; ее выражение имеет вид где … Справочник технического переводчика

Коэффициент корреляции — (Correlation coefficient) Коэффициент корреляции это статистический показатель зависимости двух случайных величин Определение коэффициента корреляции, виды коэффициентов корреляции, свойства коэффициента корреляции, вычисление и применение… … Энциклопедия инвестора

Единицы измерения информации — служат для измерения объёма информации величины, исчисляемой логарифмически.[1] Это означает, что когда несколько объектов рассматриваются как один, количество возможных состояний перемножается, а количество информации складывается. Не важно,… … Википедия

Снядецкий, Ян — Ян Снядецкий Jan Śniadecki … Википедия

Неравенство Маркова — в теории вероятностей даёт оценку вероятности, что случайная величина превзойдёт по модулю фиксированную положительную константу, в терминах её математического ожидания. Получаемая оценка обычно груба. Однако, она позволяет получить определённое… … Википедия

Единицы количества информации — Единицы измерения информации служат для измерения объёма информации величины, исчисляемой логарифмически.[1] Это означает, что когда несколько объектов рассматриваются как один, количество возможных состояний перемножается, а количество… … Википедия

Единицы измерения количества информации — Единицы измерения информации служат для измерения объёма информации величины, исчисляемой логарифмически.[1] Это означает, что когда несколько объектов рассматриваются как один, количество возможных состояний перемножается, а количество… … Википедия

Неравенство Чебышева — В Википедии существует другое неравенство, носящее имя Чебышева см. Неравенство Чебышева для сумм. Неравенство Чебышева, известное также как неравенство Биенэме Чебышева, это распространённое неравенство из теории меры и теории… … Википедия

Ян Снядецкий — Jan Śniadecki Ян Рустем. Портрет (1823) Имя при рождении: Jan Chrzciciel Władysław Śniad … Википедия

Апостериорная вероятность — условная вероятность случайного события при условии того, что известны апостериорные данные, т.е. полученные после опыта. Пример Рассмотрим приём сигнала на фоне аддитивного гауссовского белого шума . В этом случае принимаемое колебание будет… … Википедия